The draw period is about to come. Come and win your annual prize. blast.io/ZUAYK blast.io/746MA blast.io/QZKAN blast.io/QZKAN blast.io/CBSNA blast.io/NAA0S blast.io/9F9MU blast.io/9F9MU

这次openai的宫斗据彭博最新的报道起源于工程师向董事会汇报公司的一个Q项目。 工程师对Q项目的快速进展并获得的新能力可能加速AGI的实现,并可能对人类造成的影响感到担心。

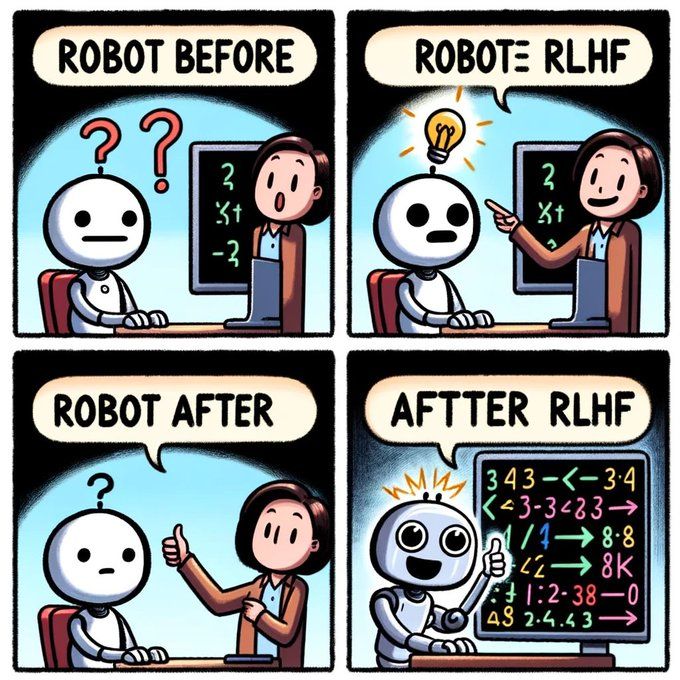

一、什么是Q项目呢? 这可能源自于一个机器学习的概念:Q学习 Q 学习是人工智能领域,特别是在强化学习领域的一个基础概念。它是一个无模型的强化学习算法,旨在学习在特定状态下一个动作的价值。 强化学习是一种机器学习的方法,它使计算机程序能够在一个环境中通过试错来学习做出决策。它不是从数据集中学习,而是通过与环境的互动,从自己的经验中学习。 强化学习简单来说就是,机器能够自学。 而Q学习是尝试找到最优的强化学习方法。 Q 学习定义在每个状态下采取的最佳动作,以最大化随时间累积的最优结果。 探索与利用:Q 学习的一个关键方面是平衡探索(尝试新事物)和利用(使用已知信息)。

二、Q 学习和通向通用人工智能的道路: 通用人工智能(AGI)是指 AI 系统理解、学习并将其智能应用于各种问题的能力,类似于人类智能。虽然 Q 学习在特定领域很强大,但它代表了通向 AGI 的一步,但还有几个挑战需要克服: 可扩展性:传统 Q 学习难以处理大型状态-动作空间,使其不适用于 AGI 需要处理的现实世界问题。 泛化:AGI 需要从学习的经验中泛化到新的、未见过的场景。Q 学习通常需要针对每个特定场景进行显式训练。 适应性:AGI 必须能够动态适应不断变化的环境。Q 学习算法通常需要一个固定的环境,其中规则不随时间变化。 多技能融合:AGI 暗示了各种认知技能如推理、解决问题和学习的融合。Q 学习主要关注学习方面,将其与其他认知功能结合起来是一个持续研究的领域。

进展和未来方向 深度 Q 网络(DQN):将 Q 学习与深度神经网络结合,DQN 可以处理高维状态空间,使其更适合复杂任务。 迁移学习:使 Q 学习模型在一个领域受过训练后能够将其知识应用于不同但相关的领域的技术可以是通向 AGI 所需泛化的一步。 元学习:在 Q 学习框架中实现元学习可以使 AI 学会如何学习,动态地适应其学习策略 - 这对于 AGI 来说是至关重要的。 Q 学习代表了 AI 中,特别是在强化学习中的一种重要方法。

因此,OpenAI 使用 Q 学习来试图实现 AGI 也就不足为奇了。

至于彭博报道的工程师在董事会开除奥特曼之前提交的关于Q项目的报告,如果因此引起了董事会这么大的反应,我们只能猜测,很可能是openai在Q学习上取得了突破性的进展。 据彭博报道,报告中称,新的模型已经在自学习能力上具备小学生的水平。 而对于消耗电力而不是生物能的模型来说,从小学进化到大学很可能只是一次升级,半天时间。 之后进化成超人智慧,可能只是以分钟计算。 如果真是这样,我们可能已经在AGI的门口。 文明飞升还是毁灭?可能很快就会知道